文/陈根

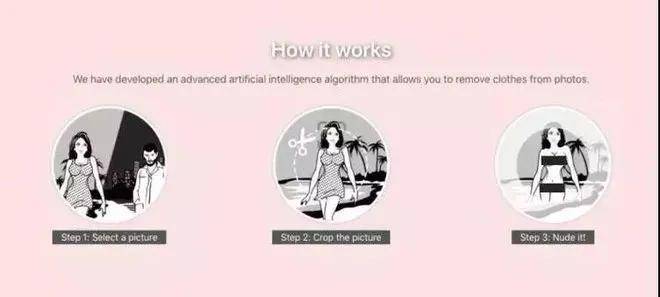

2019年6月,一款名为DeepNude的应用在海内外爆红。令其爆红的原因只有一个——只要给出一张女性照片,DeepNude借助神经网络技术,就可以自动“脱掉”女性身上的衣服,显示出裸体。

对于神经网络技术的理解门槛虽高,但应用却并不费力,因为对于使用者来说,无需任何技术知识,一键即可获取。一时间,大量色情图片在网络泛滥,很快,DeepNude级在舆论批评声中下架了。

在人们对DeepNude一键“脱衣”的震撼还未完全淡去时,这款色情的软件再次出现在了即时消息应用程序——Telegram中。而这次关于DeepNude的发现,影响更甚,危害也更大。

这项关于DeepNude的调查来自美国阿姆斯特丹的网络安全公司Sensity,这家公司专注于所谓的“视觉威胁情报”,尤其是那些深度造假视频的传播。

据Sensity报告显示,目前DeepNude已经产生了68万以上女性的假裸照,在TeleGram平台已经公开发布了约104,852张色情图片,其中70%的照片来自社交媒体或私人渠道,而这一数据还不包括私下分享传播的图片。

更重要的是,这些图片70%全部来自社交网络中的真实女性,甚至包括未成年人。这意味着,日常在Facebook、微博等社交媒体中分享的自拍照,很可能会被人用来生成“裸照”。

DeepNude成熟背后的技术背景

DeepNude的成熟,离不开一个名为DeepFakes的软件被匿名开源发布。2017年,ID为“deepFakes”发布了通过机器学习来更换视频人脸的 AI 算法。

DeepFakes是“deep machine learming”(深度机器学习)和“Fake photos”(假照片)的组合,是依托大数据和人工智能深度学习机制,基于数据算法和人脸数据库对既有视频或图片中的人物面部图像进行替换的技术工具。在开源代码库平台CitHub上,DeepFakes被描述为“一种利用深度学习技术来识别和交换图片、视频中人物脸部图像的工具”。

只要有足够的图片视频素材,有一定的硬件支持,DeepFakes就可以搭建算法匹配模型进行换脸视频的制作。具体原理思路为:对于每张脸,都训练一套编码器和相应的解码神经网络。编码时,使用的是第一个人的图片。而解码时,却是使用第二个人的解码器。而其中主要包含数据预处理、图片融合、图像预处理、网络模型、图像融合等技术。

此外,利用AI制作换脸视频除了要借助已开源的DeepFakes技术,还需要两个竞争AI系统的参与,一个是生成模型,另一个是判别模型。生成模型和判别模型的结合被称为CAN(CenerativeAderaril Netwoks,生成对抗网络技术,简称“GAN”,是深度学习原理中重要的监督学习模型),也是AI换脸最底层的逻辑。

GAN是AI机器学习中较成熟的理论,在最开始的技术中,DepFakes正是借助生成对抗网络,通过上万张照片来替换视频每秒钟存在的30个画面,最终通过GPU(CaphiesPoesing Unit,图形处理器,简称“GPU”)训练完成“移花接木”,仅凭一张照片便可实现面部替换和视频生成。

但当时该技术的使用门槛还比较高,需要编译代码等操作。然而,当DeepFakes技术的持有人在网络论坛中直接开源了该技术的算法代码并在GitHub上建立了开源项目时,一切都不一样了。

DeepFakes技术变得唾手可得,后来的AI换脸App和DeepNude出现正是基于这一技术,不同的是,对比DeepFakes需要大量的技术专业知识、庞大的数据集以及昂贵的GPU,DeepNude更容易使用,也更容易访问。时下的DeepNude操作已非常简单,只需要一张照片,上传至软件后,几秒就可以自动生成裸照,不需要任何技术知识或者专门的硬件支持。

DeepNude令人悚然的盈利背后

尽管DeepNude可供所有人免费使用,但它也有其盈利模式,未付费用户获得的裸照后会打上水印标签或者只有局部裸露,用户支付1.28美元才可以获得无水印图片,但使用权限仅限七天100张。用户也可以通过介绍他人使用这项服务来赚钱。

此外,DeepNude还在VK网站上发布了广告,据统计,在该网站上目前已经有了380页的搜索量。这种病毒式的扩张方式,让DeepNude的会员迅速增长。

根据Sensity的报告,DeepNude在去年6月就已上线,上线两个月用户几乎过万,到今年6月,已经有了4.5万用户。截至7月底,Telegram平台七个主要频道均在使用DeepNude软件。DeepNude的使用者还在telegram上成立了社区。而目前这个社区已有成员多达101,080人,其中70%居住在俄罗斯或东欧。

低门槛的使用和低廉的价格带来了可观的收益和病毒式的扩张,而背后的代价却令人警惕和感到悚然。

技术的社会属性是技术社会风险形成的根源。技术应用是一面镜子,映射出人类文明的发展水平,而DeepNude的走红则在狂欢中直逼道德底线。其恶劣的一键“脱衣”实际上打开了女性被攻击的可能性,其应用程序和易访问性更意味着女性在网上面临的更大的网络骚扰或危险题,这将对社会造成巨大影响。

一方面,DeepNude的一键“脱衣”势必会对被换脸者的声誉造成影响。除了对肖像权名誉权的侵犯,不法分子往往会利用该技术制作带有特定人脸的不雅视频进行敲诈勒索牟利。

比如,前几年合成艳照敲诈勒索官员的案例,不法分子为非法牟利,从网上搜索社会成功、知名人士的头像合成不雅照片,利用他们惧怕丑闻、顾及名誉的心理特点进行敲诈勒索。互联网时代,不雅视频或不雅图片这类信息的传播很难得到控制,给相关当事人带来的负面影响也是深远持久的。

另一方面,通过DeepNude,任何用户使用任何照片都可以生成裸照,而这将大大增加制作、传播、贩卖淫秽物品牟利犯罪可能性。

Deepfake伪造色情视频已经屡见不鲜,主要以为名人为目标。其也由最初的色情视频制作,到后来的全民娱乐、恶搞,发展到今天已经走向了制作、传播淫秽物品牟利的黑色产业。但根据一项民意调查显示,大多数用户对“现实生活中认识的女性”更感兴趣,占比达到了63%。

DeepNude恰好提供了这样的支持,从TeleGram平台的公开数据来看,许多照片中的女性都是普通上班族、大学生,而且这些照片都是来自TikTok、Instagram、Facebook等平台的自拍照。

这为色情的传播带来了新的兴奋点和吸引力,满足了相关人群猎奇、好奇等多重心理需求,容易产生一定的受众群体和市场。但这种以非法牟利为目的制作色情视图并上传到互联网甚至出售的行为,已经构成制作、传播、贩卖淫秽物品牟利罪,不仅有悖社会道德和公序良俗,更是对互联网健康环境和良好秩序的挑战。

技术与与伦理的巨大鸿沟

对于女性强有力的攻击是第一步,然后呢?新兴技术拓展了新的领域与空间,伦理规范等却还停留在过去。DeepNude只是人工智能矩阵的一个产品之一,而其本质上是一种伪造手段,除了娱乐或私欲外,其社会的危害程度不容小觑,滥用风险涉及方方面面,“深度伪造”的算法技术与与伦理之间的巨大鸿沟造成了社会频发的争议,让人谨之慎之。

人类的面部与身份特征都被数字化,算法将人的身份拆解,传统意义上的身份特质分解并与他人的身份特质再组合重构,人工智能再造的虚拟形象以拟制主体身份展现在真实的人类面前,在伦理上必然造成社会的恐慌与伦理重构。

人的体貌特征融合后不再具体的某个人典型的身份,跨越了国界种族的限制,失去了辨识度,一方面容易造成社会角色混乱与身份特征混淆。另一方面,自然人的身份被商品化也并非当下社会伦理所能接受,在相关人员不知情情况下,复制、改造他人的面孔,甚至恶意融合不雅内容以谋求金钱利益,构成对他人尊严的损害,被解构整合身份特征的人沦为被消费的商品。

此外,现阶段深度伪造的生成物所依托的技术手段足以达到以假乱真的程度,“眼见为实”不再适用,人类难以在日常的社会生活中区分数字面孔与自然人,虚假内容轻易取得信任,真伪之辨难上加难,合理的猜测与过度猜忌的界限更加难以平衡,这必然对社会造成更大的信赖难题。

真伪界限被数字化操纵,娱乐的趣味性与真相的真实性在混淆视听的人工智能生成物问世后更加模糊。“娱乐至死”的扭曲价值冲击着当下伦理观,进而引发一场社会信任危机。

最后,宗教信仰、种族国籍、国际政治领域所涉及的问题具有敏感性,更加需要真实报道与平等人权的保护,肆意更换外貌特征与伪造具有特殊意义的视频在这些领域的滥用,在社会稳定上的破坏力可能直接引发难以控制的后果。

《如何输掉信息战》一书的作者尼娜·扬科维茨(Nina Jankowicz)就指出,DeepNude对世界各地的女性都有巨大的影响,尤其是在俄罗斯这样的社会保守国家。如果一张令人信服但却是假的裸照公之于众,受害者可能面临失去工作和生计的风险。有些人可能面临伴侣暴力。

同时,利用伪造技术生成政治领袖发表不当言论的音视频,不符宗教信仰的行为,威胁国际关系的各种材料,将会大幅度增加社会关系复杂性,不利于社会稳定局面与国家长治久安。

尽管对于“深度伪造”技术的检测方式越来越多,准确度越来越高,但事实上,制造虚假视频或图像的趋势依然没有得到很好的抑制。究其原因,其一可能是AI生成虚假内容越来越方便,如DeepNude,只需要一张照片,人人都可以上手。而其二,如Sensity公司负责人所说,DeepNude目前还处于法律的灰色地带。

而人工智能“脱衣”只是数字科技所引发的科技伦理问题之一,随着人工智能类人机器人的出现,人类的两性关系与婚姻伦理将受到根本性的冲击、挑战与改变。可以说这个时代是最美好的时代,也是最具有挑战性的时代,我们的道德、价值、伦理因为科技的发展在经受着不断的挑战与冲击。

技术的伤害从来不在于技术本身,而只在于使用技术的人,对技术知识的封堵和审查,既无法阻止其扩散和传播也不利于社会的进步,最后,所有的争论都回到了人类本身,只有人心向善,才能科技至善。返回搜狐,查看更多

责任编辑: